Een mens-gedreven aanpak

Voorwoord

Ik moet toegeven: toen ik begon met het analyseren van 595 reacties op een nieuwsbericht over AI en reorganisaties, verwachtte ik de gebruikelijke mengeling van techno-optimisme en doemdenken. Wat ik aantrof was complexer, menselijker, en eerlijk gezegd: verontrustender.

Dit whitepaper is geschreven voor iedereen die zich afvraagt hoe je AI introduceert in een contactcenter zonder dat je organisatie implodeert. Managers die ‘s nachts wakker liggen van de spanning tussen efficiency-druk en menselijke verhoudingen. HR-professionals die weten dat “change management” een eufemisme is voor “hoe voorkom je dat iedereen vertrekt”. ICT-managers die begrijpen dat de beste technologie waardeloos is als niemand hem wil gebruiken. En directeuren die zich realiseren dat áls dit misgaat, de schade niet in spreadsheets te vatten is.

Wat je hier niet krijgt: een stappenplan. Geen “5 tips voor succesvolle AI-implementatie”. Geen case-study van een organisatie die het allemaal perfect deed (die bestaat niet).

Wat je wel krijgt: een denkraam. Inzicht in wat er werkelijk speelt als je over AI in contactcenters begint. En misschien belangrijker: wat je kunt verwachten als je doet alsof die menselijke kant er niet toe doet.

Ik schrijf dit vanuit lange ervaring met contactcenters. Ik heb data-analyses gemaakt, Lean-trajecten begeleid, reorganisaties van dichtbij meegemaakt. Ik weet hoe verleidelijk het is om te denken dat technologie de oplossing is. En ik weet wat er gebeurt als je die verleiding niet weerstaat.

Laten we beginnen.

1. Inleiding: spanning door AI in contactcenters

1.1 Waarom nu urgent?

November 2025. ING kondigt aan: 950 banen verdwijnen. ABN AMRO: 5.200 banen. APG: ruim 1.000. Steeds dezelfde verklaring: AI kan het werk overnemen. De financiële sector is het voorland, maar contactcenters weten: wij zijn het volgende slagveld.

En dus begint het gemompel. In wandelgangen, in OR-vergaderingen, op LinkedIn. “Wanneer zijn wij aan de beurt?” Managers die hun teams moeten geruststellen terwijl ze zelf de memo’s lezen over “toekomstbestendige organisatie-inrichting” (lees: minder mensen). Medewerkers die zich afvragen of die training volgende maand nog zin heeft. En ergens op een stafafdeling zit iemand enthousiast te rekenen hoeveel FTE je bespaart als AI 60% van de vragen overneemt.

Ik las een artikel op NU.nl. Kop: “Opkomst AI is een drogreden voor bedrijven om te reorganiseren”. Interessante stelling. Nog interessanter: de 595 reacties eronder. Daar zit de werkelijke temperatuurmeting. Niet in rapporten van adviesbureaus of persberichten van techbedrijven. Maar in wat mensen ‘s avonds laat op hun telefoon typen als ze zo’n bericht hebben lezen.

1.2 De centrale paradox

Hier is de kwestie. AI in contactcenters is er al. Het is niet alleen een technologische kwestie. De techniek werkt. Niet perfect, maar goed genoeg voor routine-vragen. Wachtwoorden resetten, pakketjes tracken, facturen toelichten. Daar is AI inmiddels best aardig in. Het is nog maar een schijntje van wat er nog mogelijk wordt.

Maar de vraag is niet of AI het kan. De vraag is of mensen het laten gebeuren.

Ik heb reorganisaties zien mislukken die technisch perfect waren. Schitterende systemen, zorgvuldig getest, keurig geïmplementeerd. En toch: adoptie 30%, medewerkers die de boel saboteren (niet eens bewust), klanten die klagen, managers die het na achttien maanden opgeven. Niet omdat het niet werkte. Maar omdat niemand ernaar vroeg wat zij ervan vonden. Er niemand luisterde.

En dus zit je met deze paradox: AI adoptie moet, want anders raak je achterop. Maar als je het verkeerd aanpakt, verlies je precies wat je nodig hebt: mensen die snappen waarom klanten bellen, die weten hoe processen echt werken, die bereid zijn nieuwe dingen te leren. Trek deze lijn eens door: slechte AI-implementatie = massa-verloop = verlies kennis = nóg slechtere dienstverlening = klanten vertrekken = organisatie in problemen.

Kom daar maar eens uit.

1.3 Aanpak van dit artikel

Ik heb die 595 reacties grondig geanalyseerd. Niet als curiositeit, maar als dataset. Wat zeggen mensen als ze denken dat niemand luistert? Welke angsten komen telkens terug? En belangrijker: wat kunnen we daarvan leren?

Dit whitepaper bouwt op die analyse.

Hoofdstuk 2 laat zien wat die reacties ons vertellen over hoe mensen AI werkelijk ervaren.

Hoofdstuk 3 gaat dieper: welke emotionele drempels moet je over voordat iemand überhaupt bereid is mee te denken?

Hoofdstuk 4 draait de rollen om: hoe maak je van passieve slachtoffers actieve vormgevers?

Hoofdstuk 5 schetst een realistische drie-fasen aanpak (niet utopisch, gewoon: haalbaar).

Hoofdstuk 6 verzamelt wat we zien bij successen en mislukkingen.

En hoofdstuk 7 confronteert je met een keuze.

Wat ik niet doe: voorschrijven. Ik observeer, ik stel vragen, ik schets consequenties. Wat je ermee doet is aan jou.

Maar laten we eerlijk zijn: als je dit leest met de gedachte “leuk verhaal, wij gaan coûte que coûte verder met AI”, dan kun je hier stoppen met lezen. Dan moet je bij een ander zijn. Iemand die je vertelt wat je wilt horen.

Nog hier? Mooi. Laten we kijken wat die 595 mensen eigenlijk zeiden.

2. Wat 595 reacties ons leren

2.1 Methodologie: Hoe geanalyseerd?

Laat ik beginnen met te bekennen dat ik aanvankelijk niet van plan was dit zo grondig te doen. Ik las het artikel, scrolde door reacties, dacht: “Ach, het gebruikelijke geneuzel”. Maar toen bleef ik hangen. Eén reactie, dan nog één, en voor ik het wist zat ik met een spreadsheet patronen te categoriseren.

595 reacties. Niet allemaal even slim (sommige mensen gebruiken de reactie-sectie blijkbaar als persoonlijke therapiesessie), maar samen vormen ze een beeld van hoe Nederland op AI en banen reageert. Weliswaar geen representatieve doorsnede, en natuurlijk met bias. Wel de mening van honderden mensen die de moeite namen om juist hierbij op Nu.nl te reageren.

Mijn uitgangspunt: Stel nu dat dit meningen zouden zijn van medewerkers in je contactcenter? Wat voor inzichten geeft dit je dan? En wat kun je met zulke wetenschap?

Ik heb ze ingedeeld op emotionele toon, argumentatiekwaliteit, psychologische patronen, en onderliggende drijfveren. Kwalitatief, geen harde statistiek. Maar patronen genoeg.

En die patronen zijn verontrustend consistent.

2.2 Dominante emoties

Angst. Dat is het eerste wat opvalt. Niet hysterische paniek, maar kalme, beredeneerde angst. “Ik ben 58, werk hier 25 jaar, wat moet ik als dit verdwijnt?” Dat soort angst. Rationeel, gebaseerd op observatie van wat anderen overkomt.

Cynisme. Het tweede patroon. “Dit is gewoon weer een manier om mensen eruit te werken terwijl aandeelhouders profiteren.” Bitter, misschien. Maar niet ongegrond. Deze mensen hebben eerdere reorganisaties meegemaakt. Ze weten hoe de vork in de steel zit.

En dan, verrassend genoeg, hoop. Niet massaal, maar aanwezig. Vooral bij jongeren. “Eindelijk hoef ik niet meer 100 keer per dag hetzelfde wachtwoord te resetten.” Ze zien AI als bevrijding van saai werk.

Data-punt

Ongeveer 48% van de reacties bevat expliciete angst of cynisme. 12% is enthousiast. 40% is afwachtend of onverschillig. Die verhouding is belangrijk: voor elke optimist zijn er vier mensen die twijfelen of actief wantrouwen.

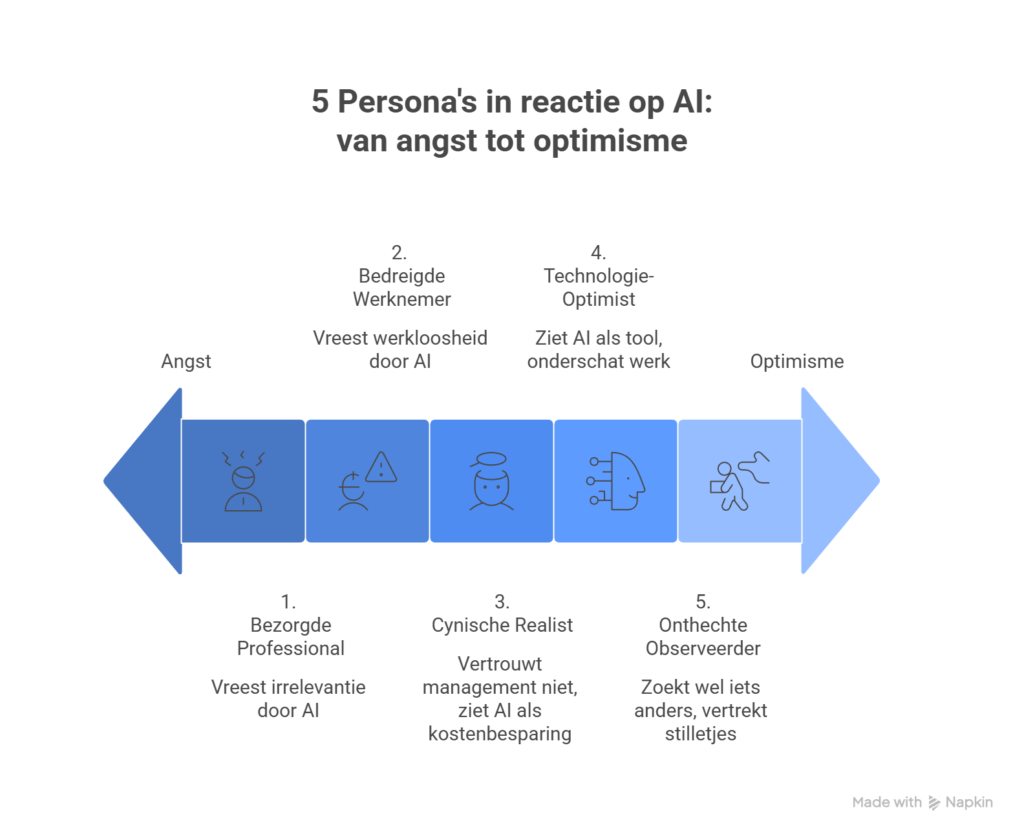

2.3 Vijf psychologische profielen

Uit de analyse kwamen vijf duidelijke persona´s naar voren. Geen hokjes (mensen zijn complexer), maar herkenbare patronen.

Profiel 1: De Bezorgde Professional (±25%)

Dit zijn je beste mensen. 35-55 jaar, tien jaar ervaring of meer, kennen klanten door en door. Ze hebben eerdere automatisering zien falen: chatbots die niemand hielpen, systemen die meer frustratie veroorzaakten dan ze oplosten. En nu komt AI. Hun reactie: “Ik betwijfel het. En wat blijft er voor mij over?”

Hun angst is niet irrationeel. Ze zien hun expertise, opgebouwd in de loop van duizenden klantgesprekken, gereduceerd tot trainingsdata. Ze vrezen niet zozeer werkloosheid, maar hun irrelevantie. En dat is een existentiële angst voor iemand wiens identiteit verstrengeld is met vakmanschap.

“Als AI expert wil ik benadrukken dat AI nog helemaal niet zo ver is dat het taken van mensen kan overnemen. Vaak zijn tientallen prompts nodig om tot een acceptabel eindresultaat te komen.”

— Reactie van IT-professional

Profiel 2: De Bedreigde Werknemer (±30%)

45-60 jaar. Lange diensttijd, maar niet doorgestroomd. Routine-gedreven. Hun prestaties zijn misschien middelmatig. Hun angst is concreter dan die van profiel 1: “Als dit verdwijnt, wat dan? Niemand neemt mij nog aan.”

Ze hebben gelijk, overigens. De arbeidsmarkt is niet mild voor vijftigers zonder specialisatie. Ze kunnen niet zomaar “omscholen naar iets met je handen”. Een advies dat regelmatig opduikt in de reacties, alsof bakker worden op je 57e een realistisch plan is.

Het pijnlijke: een deel van deze groep kan ook écht niet mee. Niet omdat ze dom zijn, maar omdat veranderingen ze te snel gaan, te ingrijpend zijn, en de context waarin ze werkten (stabiel, voorspelbaar) verdwijnt. En dat mag je zeggen. Niet meedogenloos, maar wel eerlijk.

Profiel 3: De Cynische Realist (±18%)

Alle leeftijden. Hebben reorganisaties overleefd. Vertrouwen management niet. “Het gaat helemaal niet om klanten of om ons, het gaat om kosten. En AI is het excuus.”

En weet je: ze hebben vaak gelijk. Ik heb genoeg reorganisaties gezien waarbij automatisering als drogreden werd gebruikt voor iets wat gewoon een kostenreductie-operatie was. Bedrijven die eerst de mensen eruit gooiden en dan pas bedachten hoe automatisering het zou overnemen (spoiler: dat werkte niet).

Het probleem met cynisme is niet dat het ongegrond is. Het probleem is dat het verlammend werkt. Als je ervan overtuigd bent dat alles toch een leugen is, waarom zou je dan meewerken?

Profiel 4: De Technologie-Optimist (±12%)

20-35 jaar. Digitaal native. Tech-savvy. Zien AI als tool, niet als bedreiging. “Laat AI lekker die routinevragen maar doen, dan kan ik me focussen op échte klantproblemen.”

Dit zijn je ambassadeurs. Maar pas op: ze onderschatten vaak hoeveel werk AI oplevert (training, controle, reparatie van fouten). En ze hebben weinig empathie voor collega’s die het niet zien zitten. “Gewoon leren, toch?” Alsof het zo simpel is.

Profiel 5: De Onthechte Observeerder (±10%)

“Maakt mij niet uit, ik zoek wel iets anders.” Parttime, flexpool, of bewust geen carrière-ambitie. Niet geïnvesteerd in de organisatie. Zullen stilletjes vertrekken als AI komt. Of iets anders op hun pad komt. Geen protest, geen input, gewoon: weg.

Je kunt ze niet tegenhouden. En eerlijk gezegd: moet je dat willen?

2.4 Meta-inzichten

Drie dingen vielen me op die alle profielen overstijgen.

Eén: Vertrouwenscrisis

Het woord “leugen” komt opvallend vaak voor. “Ze zeggen dit nu, maar straks doen ze toch wat ze willen.” “Management liegt.” “Het is weer een excuus.”

Dit is niet paranoia. Dit is ervaring. Mensen hebben beloftes gehoord die niet werden nagekomen. Ze zagen “tijdelijke maatregelen” veranderen in permanente afschaffing. Ze hebben “geen gedwongen ontslagen” gehoord, met in de kleine lettertjes dat “natuurlijk verloop niet wordt vervangen”.

En dus is er geen vertrouwen meer. Dat herstel je niet met een memo. Dat herstel je door te eerlijk te laten zien dat doen wat je zegt. Consequent en dat kost tijd.

Twee: Kenniskloof

Veel mensen denken dat ze over AI praten, maar hebben het eigenlijk over (inmiddels) oldskool chatbots. Of zelfs over gewone automatisering. “AI werkt niet, ik zie het elke dag falen bij mijn bank.” Maar wat ze beschrijven is vaak een slecht geprogrammeerde beslisboom uit 2018, geen large language model.

AI in contactcenters

Als we het hebben over AI dan hebben we het hier over het gebruik van AI in contactcenters.

In de context van contact centers verwijst AI naar technologieën die menselijke intelligentie nabootsen om klantinteracties efficiënter en effectiever te maken, zoals chatbots, spraakherkenning en voorspellende analyses.

Kerntechnologieën

AI omvat machine learning voor patroonherkenning in klantdata, natuurlijke taalverwerking (NLP) om gesprekken te begrijpen en te genereren, en geautomatiseerde systemen die routinetaken overnemen. Deze tools analyseren interacties in real-time, bieden suggesties aan agenten en handelen eenvoudige vragen zelfstandig af.

Praktische toepassingen

Chatbots en virtuele assistenten verwerken veelgestelde vragen 24/7, escaleren complexe issues naar menselijke agenten.

Gespreksnotities en -samenvattingen maken. Real-time coaching op klantcontact van agents.

Persoonlijke service voor klanten door analyse op eerdere interacties.

Ik hoor je denken: chatbots, spraakherkenning en voorspellende analyses, dat bestaat toch al veel langer dan AI?

Ja, dat klopt. Maar nu wordt het vaak onder de noemer van AI gebruikt in contact centers. Recente ontwikkelingen, zoals generatieve AI (GenAI), maken deze technologieën veel geavanceerder dan de eenvoudige machine learning, chatbots en spraakherkenning van vroeger. Toen waren chatbots beperkt tot scriptmatige antwoorden en regel-gebaseerde systemen (robotics). Nu verwerken ze natuurlijke taal dynamisch, leren ze van interacties en personaliseren ze service op klantniveau.

Een tandje dieper:

RAG, of Retrieval-Augmented Generation, is een eenvoudige manier om AI slimmer te maken door het eerst te laten zoeken in een database of documenten voordat het een antwoord geeft. Stel je voor: in plaats van alleen te gokken op basis van wat de AI al weet, haalt het relevante info op uit een ‘bibliotheek’ en gebruikt die om een beter, nauwkeuriger antwoord te maken. Dit voorkomt dat de AI onzin verzint, vooral bij specifieke vragen over feiten of bedrijfsinformatie.

Agentic voice AI zijn spraakgestuurde AI-assistenten die niet alleen praten en luisteren, maar ook zelfstandig beslissingen nemen en acties uitvoeren. Denk aan een virtuele medewerker die je belt, je probleem begrijpt via spraak (zoals spraak-naar-tekst en natuurlijke taalverwerking), een plan maakt en dan zelf stappen zet, zoals een boeking regelen of een database checken. In plaats van domweg commando’s op te volgen zoals Siri, handelt het proactief en leert het van eerdere gesprekken.

Samen maken ze callcenters efficiënter: RAG zorgt voor accurate info, terwijl agentic voice AI dat via spraak omzet in snelle, menselijke hulp zonder menselijke operators.

Evolutie van technologie

Oudere systemen richtten zich op basisautomatisering, zoals eenvoudige IVR’s of statische chatbots. Vaak frustrerend voor klanten door gebrek aan flexibiliteit. Ze zijn er trouwens nog steeds, geen illusies. AI combineert machine learning, NLP en GenAI voor real-time aanpassingen, sentimentanalyse en voorspellende routering van vragen en contact, wat leidt tot (en lijkt op) menselijke interacties zonder menselijke tussenkomst.

Reden voor de hernoeming naar ´AI binnen Contactcenters´

De hype rond “AI” kwam door doorbraken zoals grote taalmodellen (bijv. ChatGPT). Sinds 2022 transformeert dit contact centers transformeren naar slimme contacthubs. Dit maakt bestaande tech veel krachtiger: chatbots kunnen meer klantvragen (beter) afhandelen, AI biedt agenten live coaching in hun klantcontact, en helpt KPI’s zoals FCR te verbeteren.

Drie: Generatiekloof

Jong vs. oud is geen cliché. Het is echt. Jongeren: flexibel, optimistisch, weinig angst. Ouderen: wisselend, sommigen willen leren, anderen niet. Maar de verdeeldheid is scherp. En dat betekent: één aanpak werkt niet voor iedereen.

Wat is oud?

Ook toen uw auteur jong was, was leeftijd eenzelfde reden. En ‘oud’ begint vaak al bij 50+ helaas. Het is natuurlijk makkelijk. Maar dat het maakt het niet legitiem. Inmiddels zijn we als professionals (trouwens ook privé) een paar generaties verder met onze laptops, internet, smartphones en social media. Dus we zijn er nu bijna allemaal mee opgegroeid. En in Nederland is de acceptatiegraad van internet een van de hoogste ter wereld. En van de bevolking in de leeftijd 12-75 jaar is 98% dagelijks online.

Toch is het argument van ouderdom hardnekkig. Wat opvalt, de adoptiegraad van technologie in het privé leven van ons oudjes vaak vele malen hoger is dan de zakelijke variant. De noodzaak: iedereen kan online vakanties boeken, shoppen, bankieren, het kan vaak niet eens anders. En de fun: eindeloos scrollen en streamen, posten op social media, en heel veel meer. Dat hebben we ons allemaal zelf aangeleerd.

Dan valt het zakelijk des te meer op dat de senioren in contactcenters soms verbijsterend weinig kunnen op automatiseringsgebied zelfs voor de meest basale zaken zoals in Word, Excel, copy-paste (liever overtypen) en nog regelmatig grijpen naar pen en papier (ook overtypen) of prints ¨omdat dat makkelijker leest¨. Of, met de smartphone onder handbereik, serieus zeggen: “ik heb thuis geen internet”. Shocking.

Natuurlijk zegt dat zakelijk wat over de senioren, Vooral over degenen die in contactcenters zijn achtergebleven. Zij hebben het zich te gemakkelijk aangeleund. Maar ook over jonge(!) collega`s en managers die het hebben gezien en laten gebeuren. Dus ja, helaas, dan noemen we het hier dus een generatiekloof. Okay. I rest my case.

2.5 Wat betekent dit voor jouw contactcenter?

Stel jezelf deze vragen:

Herken je deze profielen in je team? Wie zijn jouw Bezorgde Professionals? Wie jouw Cynici? En belangrijker: wie luistert er eigenlijk naar hen?

Hoe groot is de kenniskloof? Als je morgen over AI begint, weten mensen dan waar je het over hebt? Of denken ze aan die waardeloze chatbot die klanten wegjaagt?

Wat is de status van vertrouwen? Eerlijk antwoord. Als je zegt “we doen dit samen”, geloven ze je dan?

Zorg dat je die vragen eerlijk gaat beantwoorden. Want daarmee leg je een fundament.

3. De vijf emotionele drempels

Laten we concreet worden. Wat speelt er werkelijk als je met je team gaat praten over AI? Niet inhoudelijk over “exciting opportunities”, maar wat er in hoofden gebeurt.

Ik tel vijf grote emotionele drempels. Die oversteken doe je niet met een praatje. Je moet erkennen dat ze er zijn, begrijpen waarom ze logisch zijn. Pas dan kun je nadenken over hoe je er met elkaar overheen komt.

Drempel 1: “Ik verlies mijn baan”

Wat ze voelen:

Pure, onversneden angst. Voor hypotheek. Voor pensioen. Voor niet meer kunnen bijdragen aan gezin, aan samenleving, aan iets. Werk is niet alleen inkomen. Het is identiteit. En die staat ter discussie.

Waarom dit logisch is:

Kijk naar de berichten. ING, ABN, APG. Het zijn geen kleine cijfers. 950 hier, 5.200 daar. En steeds dezelfde verklaring: AI neemt het over. Als jij in een contactcenter zit en je leest dat, wat denk je dan? “Dat overkomt mij niet?” Come on.

Bovendien: de geschiedenis leert dat bij reorganisaties vooral de kwetsbare groepen worden geraakt. 50-plussers. Mensen zonder hbo-diploma. Mensen die niet snel genoeg meegaan met nieuwe technologie. Dat is geen complottheorie. Dat is empirie.

Wat ze nodig hebben:

Niet: “Maak je geen zorgen.” Want dat is een leugen. Wel: eerlijkheid over wat er verandert, gecombineerd met concrete stappen. “Ja, je werk verandert ingrijpend. Nee, we gaan niet zomaar mensen ontslaan. Wel gaan we samen kijken hoe we jouw expertise op een nieuwe manierkunnen inzetten. En dat begint met dit gesprek.”

Zie je het verschil? Niet ontkennen, niet sussen, maar erkennen én handvatten bieden.

Drempel 2: “Management liegt”

Wat ze voelen:

Cynisme. Wantrouwen. “Ze zeggen nu dat het niet om kosten gaat, maar uiteindelijk gaat het altijd om kosten.”

Waarom dit logisch is:

Omdat het vaak waar was. Ik heb genoeg reorganisaties gezien waarbij het officiële verhaal (“kwaliteitsverbetering”, “toekomstbestendig maken”) camouflage was voor: we willen goedkoper opereren. En medewerkers zijn niet achterlijk. Die zien verschil tussen oprecht en bullshit.

“Profit over people. Zal altijd zo blijven. Eerst winst, dan winst, dan nog wat winst…”

— Anonieme reactie

Bovendien: bedrijven die miljoenen, zelfs miljarden winst maken en toch mensen ontslaan? Dat voedt cynisme. Terecht, wat mij betreft.

Wat ze nodig hebben:

Transparantie. Échte transparantie, niet corporate-blabla. “Ja, AI moet uiteindelijk rendabel zijn. Ja, dat betekent dat niet iedereen hetzelfde werk blijft doen. Nee, dit is geen snelle kostenreductie—we investeren de komende twee jaar meer dan we besparen. En toch zal er nu en later heel veel veranderen. Hier zijn de cijfers.”

En dan: bewijs leveren. Niet alleen maar praten, maar wat doe je. Beloftes nakomen. Open boeken tonen. Wekelijks updaten. Zo herstel je vertrouwen. Langzaam, moeizaam, maar het is de enige weg.

Drempel 3: “AI werkt toch niet”

Wat ze voelen:

Professionele frustratie. “Ik zie het elke dag falen. Chatbots die onzin uitkramen. Klanten die boos worden. En nu gaat dit het wél oplossen?”

Waarom dit logisch is:

Omdat veel automatisering inderdaad waardeloos is. Ik heb klanten zien worstelen met chatbots die niet eens de meest simpele vraag begrepen. IVR-systemen waar je tien minuten doorheen moet voor je een mens spreekt. Portals die crashten bij piekdrukte. En dat heet dan “service-verbetering”.

Ze hebben gelijk dat AI geen wondermiddel is. De huidige generatie maakt nog genoeg fouten. En als je training slecht is (garbage in, garbage out), blijft het prutswerk.

AI blunders

Je kent ze vast ook, smakelijke AI mislukkingen die tot de verbeelding spreken. Ze doen het ook goed als borrelpraat en op verjaardagen. Natuurlijk zijn die kwalijk als er leed of schade mee wordt veroorzaakt. Criticasters grijpen die voorbeelden aan als feiten (dat zijn ze ook) om AI impact teniet te doen. Tegelijk leidt dat tot struisvogelpolitiek die wegkijkt van AI successen. Een open én kritische blik brengt je verder.

McDonald’s Drive-Thru AI (2022)

IBM’s spraak-AI voor McDonald’s drive-throughs voegde herhaaldelijk verkeerde items toe, zoals 260 Chicken McNuggets, wat virale hilariteit en verwijdering uit filialen veroorzaakte. Dit illustreerde schaalbaarheidsproblemen bij real-world AI.

Gemini Afbeeldingsbias (2024)

Google’s Gemini genereerde historisch inaccurate afbeeldingen met gedwongen diversiteit, zoals om Nazi-soldaten als niet-witte mensen (lees: mensen van kleur) af te beelden, wat leidde tot publieke vernedering en tijdelijke stopzetting van de functie.

Google Bard´s Pizza Advies (2024)

Plak kaas met lijm op je pizza want dan blijft het beter zitten. Nederlandse media zoals NOS Jeugdjournaal en Het Klokhuis bespraken het als voorbeeld van AI-hallucinaties door training op onbetrouwbare webdata. Het advies was gebaseerd op een sarcastische oude Reddit-post waarbij AI de clou van de grap volledig miste.

Wat ze nodig hebben:

Erkenning. “Je hebt gelijk dat veel implementaties slecht zijn. Daarom willen we het anders aanpakken. Samen met jullie gaan bepalen wanneer AI goed is. Niet ICT, niet management of consultants. Jullie. Want jullie weten wat klanten nodig hebben.”

En dan: laten zien. Demo’s. Pilots. Laat ze zelf testen. Laat ze fouten vinden. Maak ze quality gate. Dan verschuift de mindset van “weer zo’n technologie-hype” naar “we bouwen dit samen, en het moet aan onze eisen voldoen”.

Drempel 4: “Ik ben te oud”

Wat ze voelen:

Schaamte. Machteloosheid. “Ik snap die nieuwe dingen niet meer. Jonge collega’s lachen me uit. Ik ben niet goed genoeg.”

Waarom dit logisch is:

Omdat de maatschappij dat vertelt. “Ouderen kunnen niet meekomen met technologie.” En omdat ze het zien: jongeren die moeiteloos nieuwe systemen oppikken terwijl zij nog worstelen met het CRM dat drie jaar geleden werd ingevoerd.

Maar hier zit ook een misvatting. Het gaat niet om leeftijd. Het gaat om leerbereidheid. Ik ken genoeg vijftigers die nieuwsgierig zijn, vragen stellen, durven experimenteren. En ik ken dertigers die bij elke verandering klagen.

Wat ze nodig hebben:

Nuance. “Het gaat niet om leeftijd, het gaat er om of je wilt leren. En je hoeft geen programmeur te worden. Je kunt AI trainen met jouw klantkennis. Je kunt nieuwe collega’s mentoren. Je kunt complexity-specialist worden.”

Maar ook: eerlijkheid. “Als je dit écht niet zit zitten, dan wordt het lastig. Niet omdat we gemeen zijn, maar omdat de wereld verandert. En dan moeten we praten over een goede uitstap.”

Zie je: beide kanten. Perspectief én realisme.

Drempel 5: “Ik word niet gehoord”

Wat ze voelen:

Frustratie. Machteloosheid. “Ze doen toch wat ze willen en nemen alle beslissingen. Waarom zou ik mijn mening geven?”

Waarom dit logisch is:

Omdat dat hoe het meestal gaat. Management bedenkt plan. HR maakt implementatie-roadmap. ICT bouwt systeem. En dan krijgen medewerkers een presentatie of training: “Dit is hoe het gaat werken.”

Dat heet geen participatie. Dat heet informeren. En mensen voelen het verschil.

Wat ze nodig hebben:

Échte invloed. Niet: “We houden rekening met jullie input.” Maar: “Jullie ontwerpen dit. Jullie krijgen budget. Jullie bepalen prioriteiten. En als management iets wil wat jullie niet willen, dan moet management jullie overtuigen.”

Ik weet het. Eng. Want dan verlies je als management controle. Maar hier is het geheim: die controle heb je sowieso niet. Mensen zullen onbewust, ongewild (of erger) je plannen saboteren. Of ze kunnen er eigenaar van zijn. Jouw keuze.

Reflectievraag:

Welke van deze drempels ligt het hoogst in jouw contactcenter? En wie zou je kunnen vragen om eerlijk antwoord te geven (en zou je hen geloven)?

4. Van passief naar actieve betrokkenheid

Tot nu toe hebben we gekeken naar wat er is: angst, cynisme, wantrouwen. Logisch, begrijpelijk, onontkoombaar. Maar je kunt daar niet blijven steken. De vraag is: hoe verander je de dynamiek?

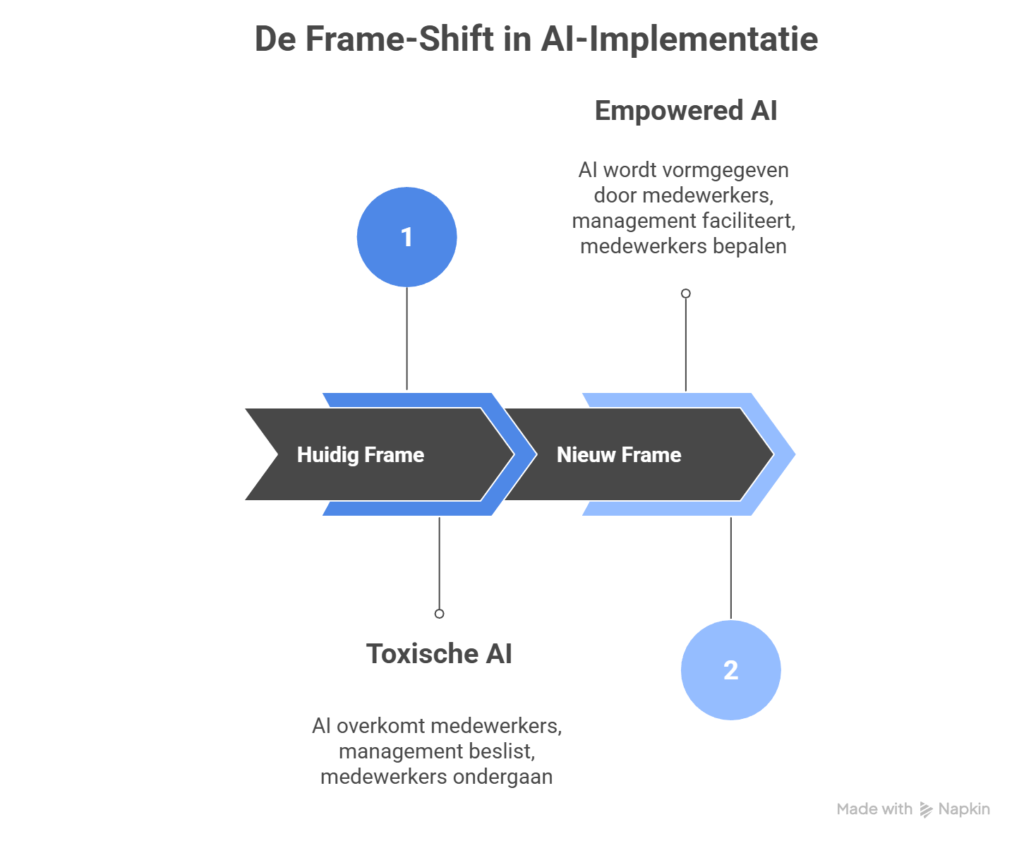

4.1 De Frame-Shift

Het huidige frame is toxisch:

- AI overkomt medewerkers

- Management beslist

- Medewerkers ondergaan

Dit frame leidt tot weerstand. Altijd. Niet omdat mensen dom of dwars zijn, maar omdat niemand graag passief slachtoffer is van andermans plannen.

Het nieuwe frame:

- AI wordt vormgegeven door medewerkers

- Management faciliteert

- Medewerkers bepalen

Medewerkers bepalen

Natuurlijk is de juiste technische expertise nodig om AI ¨te bouwen¨. Dus daar heb je uiteraard techneuten bij nodig.

Maar AI heeft ook kennis nodig. Kennis die, al dan niet via een kennisbank, databases en documenten, van mensen afhangt. En naast die kennis, moet ook het gebruikersgemak de mens dienen.

Dus gaat het niet alleen of je juiste antwoorden en oplossingen krijgt met AI maar is ook gebruiksvriendelijkheid een vereiste.

Als we zeggen dat “medewerkers bepalen”, doelen we vaak de kwaliteitscheck op input en output. Als we het hebben over gebruiksgemak, zit de medewerker ook op de stoel van de klant. Om blinde vlekken te voorkomen, is het natuurlijk nòg beter de klant om feedback te vragen op verschillende stadia. De investering moet immers klantwaarde brengen! Toch is het aspect Klantwaarde niet de scope van dit artikel.

ICT-ers. Hier veronderstellen we dat de reacties en emoties van contactcenter agents afkomstig zijn. Toch zou de theorie van emoties en angsten en persona’s net zo goed kunnen opgaan voor de medewerkers van de IT-afdeling in je bedrijf of organisatie. Want ook een traditionele IT-er is nog geen AI-expert. Voel je vrij om dit artikel te lezen alsof het over hén gaat.

Klinkt mooi, hoor ik je denken. Maar hoe doe je dat?

4.2 Vier Perspectieven

Ik zie vier manieren waarop je de dynamiek rondom AI kunt omdraaien. Geen trucjes, geen quick wins. Gewoon: anders denken over wat AI is en wat mensen doen.

Perspectief 1: AI als collega (niet als vervanger)

Stop met praten over “AI of mensen”. Begin met “AI én onze mensen”. Ze zijn goed in verschillende dingen:

- AI: routine, snelheid, 24/7, consistentie

- Mens: empathie, complexiteit, improvisatie, relatie

Samen zijn ze sterker dan apart. En dat is geen holle frase. Ik zie het in contactcenters waar AI de eerste lijn doet (wachtwoorden, statussen, simpele vragen) en mensen de tweede lijn (alles wat genuanceerd is, emotioneel, juridisch complex). Klanten tevreden. Medewerkers tevreden. KPI’s omhoog.

Maar het vereist dat je accepteert dat AI niet alles doet. En dat mensen niet overbodig zijn. Beiden zijn waar. Wat ook waar is: de panelen gaan natuurlijk met de tijd verder verschuiven. AI zal steeds meer kunnen. Ontken dat vooral niet.

Perspectief 2: Eerst investeren (dan besparen)

Hier komt de lastige waarheid: AI kost in het begin geld. Veel geld. Technologie, training, tijd van mensen, fouten maken, opnieuw beginnen. Jaar één en twee ben je duurder uit. De lasten gaan dus voor de baten uit.

Pas in jaar drie begint het misschien rendabel te worden. En dat betekent: geduld. Geen druk op snelle ROI. Geen halverwege de kosten uit het project halen. Geen “we hadden toch gezegd dat het zou besparen?” op maand zes.

Data-punt

Uit industrie-benchmarks (McKinsey, Gartner): AI-projecten in contactcenters bereiken break-even na 18-24 maanden. Wie sneller wil, faalt meestal.

Agentic Voice AI in Enterprise Call Centers

The AI Revolution Is Here. So Why Are 85% of Customer Service AI Projects Failing?

Perspectief 3: Nieuwe rollen zijn echt

Ik hoor vaak: “Er komen ook nieuwe banen bij.” Meestal gevolgd door mensen die met hun ogen rollen van wie die belofte al veertig jaar hoort. En eerlijk: vaak gebeurt het niet.

Maar in dit geval wél. Want AI moet getraind worden. Iemand moet bepalen wat acceptabele antwoorden zijn. Iemand moet complexe escalaties oppakken. Iemand moet analyseren waarom klanten überhaupt bellen.

Rollen die mogelijk in je organisatie zullen ontstaan:

- AI-Agent Trainer / Conversation Designer

- Quality & Compliance Officer

- Escalatie-Specialist / Chaos-navigator (complexity-specialist)

- Data-driven QA Specialist

- Data-Analist Klantbeleving / Root Cause Analist

Niet iedereen wordt dit. Maar deze nieuwe functies ontstaan. En ze vragen om mensen die klanten snappen én technologie durven omarmen.

Perspectief 4: Eerst Klantwaarde, kostenreductie op tweede plaats

Dit is misschien het moeilijkste perspectief, omdat het ingaat tegen alles wat management leert op business school. Maar luister:

Als je AI alleen inzet om kosten te besparen, bespaar je op korte termijn inderdaad. Maar pas op: slecht uitgevoerd verlies je klanten (slechte ervaring), mensen (verloop), kennis (vertrek experts). Schade die je maar moeilijk herstelt.

Als je AI inzet om klanten beter te helpen, stijgt je CES of CSAT, stijgt je NPS, dalen repeat-calls, help je klanten sneller of beter, hopelijk vaker pro-actief.

En dan het niet onbelangrijke bijeffect: kosten dalen. Niet omdat je mensen ontslaat, en niet eens per sé door AI maar gewoon omdat je onder de streep efficiënter werkt.

Ik weet het. Counter-intuïtief. Maar deze insteek helpt je wel.

Reflectievraag:

Welk van deze vier perspectieven voelt het meest natuurlijk voor jouw organisatie? En welke voelt als het moeilijkste gesprek?

4.3 Waarom dit werkt (psychologie + data)

Kort door de bocht: mensen werken mee als ze het gevoel hebben dat het hun eigen plan is. Niet als ze verteld worden wat ze moeten doen.

Uit onderzoek (McKinsey, diverse change-management studies): projecten waarin medewerkers vanaf het begin betrokken zijn, hebben 3× hogere slaagkans. Omdat de plannen beter zijn (dat zijn ze vaak ook), en omdat er eigenaarschap is.

Borgen van veranderingen: wat is daarvoor nodig?

En eigenaarschap leidt tot betrokkenheid. En betrokkenheid leidt tot kwaliteit. En kwaliteit leidt tot succes.

Het is niet ingewikkeld. Het is gewoon anders dan hoe we het gewend zijn.

5. De drie-fasen aanpak

Genoeg theorie. Laten we concreet worden. Als je morgen begint (niet letterlijk morgen, maar je snapt me), hoe pak je het dan aan?

Ik onderscheid drie fasen. Geen strakke tijdlijnen (elke organisatie is anders), maar wel een logische volgorde. En één harde regel: je kunt fase 2 niet overslaan om sneller bij fase 3 te komen. Dat eindigt in drama.

Fase 1: Luisteren & leren (6 maanden)

Doel: Fundament leggen. Vertrouwen opbouwen. Begrijpen wat er speelt.

Hoe ga je te werk?

Begin met erkennen dat je het niet weet. Echt niet. Je weet niet precies welke angsten leven. Je weet niet welke medewerkers mee willen en welke niet. Je weet niet waar weerstand zit en waar energie.

En dus: vragen.

Concrete acties:

- Teamgesprekken (geen presentaties, gewoon: praten)

- Individuele gesprekken (vrijwillig, veilig, niet oordelen)

- AI-basistraining (externe experts, geen intern gepruts)

- Werkgroep formeren (diverse samenstelling: jong/oud, optimist/sceptisch)

- Eerste concepten (door werkgroep, niet door management)

Let op wat je niet doet: beslissingen nemen. Plannen presenteren. Tijdlijnen vastleggen. Je bent aan het leren. Niet aan het implementeren.

Output:

Eind juni: Plan van Aanpak dat door medewerkers is ontworpen (met begeleiding, zonder te dicteren).

Valkuilen die we zien:

- Management verliest geduld (“Wanneer gaan we nu echt beginnen?”)

- Medewerkers blijven wantrouwig (“Leuk gesprek, maar wat verandert er?”)

Hoe je dat voorkomt:

- Wekelijkse updates (ook als er weinig gebeurt)

- Quick wins (demo die werkt, enthousiaste expert op bezoek)

- Transparantie over voortgang (dit lukt, dit lukt nog niet, dit weten we niet)

Fase 2: Prototypen & testen (6 maanden)

Doel: Doen. Falen. Leren. Verfijnen.

Hoe ga je te werk?

Nu ga je bouwen. Maar niet alles tegelijk. Start klein. Eén use case. Bijvoorbeeld: wachtwoord-resets. Boring, low-risk, hoog volume. Perfecte pilot.

Concrete acties:

- Pilot met voldoende volume om effect te meten (kies bewust met welke klanten?)

- Wekelijkse retrospectives (wat ging goed? wat fout? wat leren we?)

- Iteratie v2.0 (verbeteren op basis van feedback)

- Training op selecte groep medewerkers;

- nieuwe rollen (AI-trainers, escalatie-specialisten)

- Evaluatie na 6 maanden (go/no-go voor een vervolg)

Let op wat je wél doet nu: fouten maken. En dat is OK. Sterker: dat móet. Want alleen door te falen leer je wat werkt.

Output:

Na 2×6 maanden: Werkend AI-systeem voor één soort vragen. Eerste nieuwe functies en hun -beschrijvingen. Implementatieplan voor 2027.

Valkuilen:

- AI-kwaliteit valt tegen (frustratie bij medewerkers én klanten)

- Druk om te snel op te schalen (“Het werkt toch al?”)

Hoe je dat voorkomt:

- Strenge kwaliteitseisen vooraf (AI mag pas live als medewerkers zeggen “dit is goed genoeg”)

- Communiceren dat eerste jaar = leerjaar, niet resultaatjaar

Fase 3: Schalen & transformeren (bijv. 2027-2030)

Doel: Van prototype naar standaard. Van project naar cultuur.

Hoe ga je te werk?

Nu wordt het serieus. Je schaalt op naar 80% van volume van hetzelfde eerste onderwerp. Medewerkers uit eerste groep trainen tweede lichting medewerkers. Je gaat verder dan AI.

2027:

Daarna in stappen uitrol naar vaste set van routine-vragen. Training alle mensen naar nieuwe werkwijze en rollen. Root cause analyses (waarom bellen ze?).

AI en grondoorzaken

Vanuit mijn Lean achtergrond kijk ik met gemengde gevoelens naar het idee om op termijn AI meer en meer klantvragen te laten beantwoorden. Vaak zijn klantvragen namelijk reactief van aard. Een bedrijf of organisatie creëert veel (stel: 80%) situaties waarin zich geroepen vanuit onduidelijkheid contact te zoeken. Dan lijkt het misschien een goedkope oplossing om die klantvragen te automatiseren om dure manual labour te vervangen. Dit kan zich zelfs tegen de onderneming keren: dan heb je als klant een vraag over steeds diezelfde slechte brief of factuur en dan krijg je niet eens meer een echt mens die het voor je oplost.

Dus of het nu mensen of AI-oplossingen zijn, inzet ervan is het goedkoopst als het onduidelijkheden, vragen of problemen voorkomt. Dus: Pro-actief klantwaarde toevoegt. En grondoorzaken wegneemt.

Makkelijkste voorbeeld: stel minstens 20% van klantvragen zijn statusvragen: waar is het, waar blijft het, hoe staat het ermee? Je kunt AI dan inzetten om dit reactief te beantwoorden. Maar je de zorg van de klant pas weg te nemen, door die updates op voorhand te verstrekken. Je managet verwachtingen én voorkomt onverwachte vragen.

2028:

Proces-optimalisaties. Reduceer volumes al bij de bron. Nieuwe diensten (proactief contact). Niet alleen door AI (zie voorbeeld van statusvragen) maar nog belangrijker: door mensen. Dankzij AI vrijgespeelde capaciteit kom je eindelijk toe aan langverwachte zaken zoals retentie of behoud.

2029-2030:

AI + Mens volledig geïntegreerd. Contactcenter wordt “Customer Success Center”. Focus verschuift van volume naar waarde.

Output:

Een organisatie die met AI optimaal en fundamenteel anders werkt dan in de jaren ervoor. Niet alleen maar efficiënter, maar beter. Voor klanten, voor medewerkers, voor de zaak.

Reflectievraag:

Als je eerlijk bent: zou je bang zijn dat misgaat in deze drie fasen? Waarom? Met wie zou je daarover durven praten?

6. Kritische succesfactoren

Dat klonk allemaal erg makkelijk misschien. Wat maakt nu dat implementaties slagen? En wat maakt dat ze falen?

Ik heb de afgelopen jaren 50+ projecten van dichtbij gevolgd. Eigen werk, data van collega’s, industrie-rapporten. Patronen zijn consistent. Niet verrassend, maar wel confronterend.

6.1 Hoe zien succesvolle implementaties eruit?

Observatie 1: Mensen zitten vanaf dag 1 aan tafel

Niet slechts geïnformeerd. Of geconsulteerd. Nee: aan de tafel waar beslissingen vallen. Met beslisrecht. Met budget. Met mandaat.

Dit vertraagt soms besluitvorming. Consensus kost tijd. Maar het verhoogt acceptatie dramatisch. En uiteindelijk ga je sneller, omdat je later veel minder weerstand hoeft te overwinnen.

In één organisatie zag ik dit: werkgroep van 12 medewerkers kreeg €50k eigen budget om een pilot vorm te geven. Management was alleen de sponsor en sparringpartner, maar niet de baas. Resultaat: plan dat beter was dan wat management had bedacht, én 95% adoptie bij collega’s.

Observatie 2: Er wordt geïnvesteerd vóórdat er wordt bespaard

Succesvolle organisaties rekenen niet op break-even in jaar één. Ze accepteren dat de eerste paar jaar duurder zijn. Ze reserveren budget voor training, voor tijd van mensen, voor fouten maken.

En ze waken erover dat budget halverwege toch onder druk komt om toch te bezuinigen. “We hadden verwacht dat het al rendabel was.” Nee, dat had je niet verwacht. Je hoopte het. Verschil.

Observatie 3: Kwaliteit is niet-onderhandelbaar

AI gaat pas live als het goed genoeg is. Niet als de planning zegt dat het moet. Niet als de CFO zegt dat het geld op is. Maar als medewerkers zeggen: dit is goed, dit kunnen we aan klanten geven. En klanten het er volmondig mee eens zijn.

Bij een grote bank blokkeerde de werkgroep drie keer de livegang. Frustratie bij ICT, bij management. Maar toen het eindelijk live ging: 0 grote incidenten, 92% CSAT, enthousiasme van medewerkers. Want ze wisten: dit is goed.

Observatie 4: Er is transparantie over alles

Budgetten, tijdlijnen, risico’s, mislukkingen. Alles wordt gedeeld. Niet alleen maar goede nieuws. Juist de problemen.

Dit voelt eng. Want het betekent kwetsbaarheid. Maar het bouwt aan onderling vertrouwen. Mensen zien dat je eerlijk bent, ook als het tegenzit.

Observatie 5: Fouten maken mag (sterker: moet)

Pilots die falen zijn geen ramp. Dat zijn leermomenten. Organisaties die dit begrijpen, experimenteren sneller, leren sneller, worden beter. In een Agile aanpak behoeden de iteraties je juist voor erger. Je hebt de mogelijkheid om steeds bij te stellen.

Organisaties die falen aangrijpen als bewijs dat zulke participatie niet werkt? Die blijven hangen in analyse-paralyse en doen nooit iets, wezenlijks, anders.

Reflectievraag:

Welke van deze vijf observaties zou in jouw organisatie het moeilijkst te verkopen zijn aan management? En waarom?

6.2 Wat we zien bij mislukkingen

Rode vlag 1: ICT maakt plan zonder medewerkers

Klassiek patroon. ICT krijgt opdracht: “Implementeer AI.” Ze bouwen prachtig systeem. Technisch perfect. En dan komt go-live. Medewerkers gebruiken het niet. “Het werkt niet.” “Het is onhandig.” “Klanten klagen.”

Niet omdat de techniek slecht is. Maar omdat niemand vroeg wat medewerkers nodig hadden.

Rode vlag 2: Management pusht voor snelle ROI

“Over zes maanden moet het break-even zijn.” Dit is dodelijk. Want AI-implementatie kost nu eenmaal tijd. Training, testen, itereren. Als je dat afkapt omdat het te lang duurt, heb je een half-af systeem.

En half-af systemen zijn slechter dan geen systeem.

Rode vlag 3: Beloftes worden gebroken

“Geen gedwongen ontslagen.” En dan, maand acht: reorganisatie. “Ja maar dat was al gepland.” Maakt niet uit. Je had beloofd van niet.

Vertrouwen opbouwen duurt jaren. Vertrouwen verliezen duurt seconden. En daarna krijg je het nooit meer terug.

Rode vlag 4: Er is geen geduld voor leren

“De pilot duurt te lang.” “Kunnen we niet sneller?” “Concurrent X heeft het ook al.”

Dit is een managementreflex. Haast maken. Maar bij AI is haast maken langzamer gaan. Want dan maak je fouten, dan moet je terug, om opnieuw te beginnen.

Rode vlag 5: Kritiek wordt niet gehoord

Medewerkers wijzen op problemen. “Deze functie werkt niet goed.” “Klanten klagen hier over.” En management zegt: “Went wel.” Of: “Jullie moeten positiever zijn.”

Dit is hoe je je beste mensen verliest. Want die zien het ´t eerst, die zeggen het eerlijk, en als je dan niet luistert: die vertrekken het snelst.

Reflectievraag:

Eerlijk: herken je rode vlaggen in jouw organisatie? En hoe zou je dat anders doen?

6.3 Reflectievragen voor jouw situatie

Ik ga je niet vertellen wat je moet doen. Maar ik ga je wel vragen stellen waar je niet omheen kunt.

Over vertrouwen:

- Wat heb je in het verleden beloofd dat je niet hebt waargemaakt?

- En als je morgen zegt “we gaan dit samen doen”, hoeveel procent gelooft je dan?

- Hoe ga je dat vertrouwen herstellen?

Over kennis:

- Snappen je medewerkers wat AI is (vs. chatbot, vs. automatisering)?

- Heb je budget om hen goed te informeren, te inspireren, te trainen?

- Wie gaat ze professioneel trainen? (Niet ICT, hoop ik.)

Over tijd:

- Wat is de tijdsdruk?

- Hoeveel geduld heeft je organisatie?

- Wat gebeurt er als de pilot bijv. twee jaar duurt in plaats van één?

Over macht:

- Wie beslist of AI live gaat? Management of medewerkers?

- Hebben medewerkers écht invloed of is het cosmetisch, voor de bühne?

- Wat gebeurt er als hun advies ingaat tegen wat management wil?

Over regie:

- Wie nemen deel aan dit project? Managers, agents, HR, ICT, etc?

- Wie heeft en beheert het budget? Één afdeling of gedeeld?

- Wie heeft er veto-recht? Is dat gebruikelijk?

Dit zijn ongemakkelijke vragen. Maar als je ze niet beantwoordt vóór je begint, beantwoordt de realiteit ze voor je. En dat loopt soms niet zoals je had gehoopt.

7. Twee verschillende scenario´s

Laat ik concreet worden. Twee organisaties. Beide contactcenters, vergelijkbaar qua grootte, zelfde sector. Beide besluiten AI in te voeren. Kijk wat er gebeurt.

Scenario A: zoals gebruikelijk

Maart 2026. Directie besluit: AI gaat komen. Tijdsdruk (concurrent doet het ook). Budget is goedgekeurd. ICT krijgt opdracht.

ICT maakt plan. Kiest platform. Bouwt systeem. Drie maanden later: demo aan management. “Ziet er goed uit.” Go-live gepland: september.

Juni 2026. Managers krijgen te horen: “Vanaf september werken we voor e-mail met AI. Informeer je team.” Korte presentatie. Weinig vragen (mensen durven niet). Één opmerking: “Vervangt dit banen?” Antwoord: “Nee hoor, we gaan efficiënter werken.”

September 2026. Go-live. Chaos. AI snapt de helft van de vragen niet. Klanten boos. Andere contactkanalen lopen over. Medewerkers werken extra. “Zie je wel, het werkt niet.”

ICT: “Het is een leercurve.” Management: “Jullie moeten het een kans geven.” Medewerkers: gefluister in de wandelgangen. Ongenoegen op social media.

December 2026. CSAT is gedaald met 12 punten. Drie beste medewerkers zijn vertrokken. OR dreigt met formele procedure. ICT werkt aan patch v2.0.

Maart 2027. Directie overweegt project te stoppen. €500k weggegooid. 2x vertrouwensbreuk: van hun medewerkers en in AI. Los dat nog maar eens op.

Scenario B: mens-gedreven

Maart 2026. Directie besluit: AI komt eraan. Maar (en let op dit verschil): “We weten niet precies hoe. Daar hebben we mensen voor nodig die het werk doen.”

Managers krijgen training in mensen-gedreven verandering. Niet: hoe implementeer je techniek. Maar: hoe voer je gesprekken over angst en emotie bij de impact van AI.

April 2026. Teamgesprekken. Manager begint: “Ik wil het met jullie hebben over AI. Ik weet dat er onrust is. Ik weet dat jullie vragen hebben. Ik heb ze ook. Laten we eerlijk zijn over wat we wel en niet weten.”

Ruimte voor vragen. Geen mooipraterij. “Ja, je werk zal veranderen. Nee, we gaan niet zomaar mensen ontslaan. Wel gaan we samen kijken hoe dit eruit kan zien.”

Mei 2026. Individuele gesprekken. Vrijwillig. Veilig. Wat denk jij? Waar ben je bang voor? Wat zou je willen?

Juni 2026. Werkgroep van met aantal agents. Diverse samenstelling. Opdracht: Ontwerp hoe AI hier zou kunnen werken. Budget: €50k. Tijd: 8 uur per week vrijgemaakt.

September 2026. Werkgroep presenteert. Niet eerst aan directie. Aan collega’s. Discussie. Aanpassingen. Consensus.

December 2026. Pilot start. 20% van volume van één use case: wachtwoord-resets. Boring. Simpel. Low risk. Selecte groep klanten. Direct feedback.

Maart 2027. Evaluatie. Werkt redelijk. Nog niet perfect. CSAT stabiel. Medewerkers zien dat het nut heeft. “OK, dit kunnen we uitbreiden.”

September 2027. Uitrol naar 60% volume op dezelfde case. Nieuwe rollen voor meer agents (AI-trainers, escalatie-specialisten). Vragen: salaris omhoog? (want complexer werk). Verloop daalt (van 25% naar 18%).

December 2027. NPS +8 punten. Kosten -12% (niet door ontslagen, maar door efficiency). Medewerkers-tevredenheid +15 punten. Concurrent komt op bezoek: “Hoe hebben jullie dit gedaan?”

Zie je het verschil? Niet in de techniek. In de aanpak.

En nu de confronterende vraag:

Welk scenario herken je. Hoe pakt jouw organisatie dit normaal gesproken aan?

8. Call-to-action

8.1 Dit is geen blauwdruk

Laten we beginnen met wat dit niet is. Dit is geen stappenplan. Geen “volg deze 7 stappen en het lukt gegarandeerd”. Want zo werkt het niet.

Elke organisatie is anders. Andere cultuur, andere mensen, andere geschiedenis. Wat bij de één werkt, faalt bij de ander. En dat is OK.

Wat ik je wel gegeven heb: een denkraam. Inzicht in wat er speelt als je over AI begint. Handvatten om gesprekken te voeren. Waarschuwingen over waar het misgaat.

De rest moet je zelf invullen. En dat is angstig, ik weet het. Maar het is ook de enige manier.

8.2 Beginvragen voor verschillende rollen

In plaats van “doe dit”, stel ik je vragen. Beantwoord ze eerlijk. Voor jezelf. Met je team. Met je baas. En kijk wat eruit komt.

Als je Manager bent:

Hoeveel vertrouwen is er? Als je morgen zegt “we gaan dit samen doen”, geloven ze je dan? Waarom wel of niet?

Ken je de angsten? Niet wat jij denkt dat je mensen denken. Maar wat ze werkelijk denken. Heb je dat gevraagd?

Heb je geduld? Als dit twee jaar duurt in plaats van zes maanden, accepteert jouw directie dat?

Durf je kwetsbaar te zijn? Kun je zeggen “ik weet het niet” en “ik heb jullie nodig”? Of moet je altijd antwoorden hebben?

Wat als het faalt? Letterlijk: wat gebeurt er met jou als de pilot mislukt? Want als het antwoord is “ik word ontslagen”, ga je de verkeerde beslissingen nemen.

Als je HR-Professional bent:

Zit je aan tafel? Bij strategische beslissingen over AI en de verandering voor mensen in functie en ontwikkeling. Niet om te adviseren maar om te beslissen.

Heb je budget? Voor training, voor begeleiding, voor tijd van mensen. En kun je dat budget en de planning beschermen als er meer druk komt?

Ken je de profielen? Wie zijn je Bezorgde Professionals, je Cynici, je Optimisten? En heb je voor elk een aanpak?

Wat als mensen het niet redden? Letterlijk: wat bied je iemand van 57 die écht niet mee kan? (En “omscholen” is geen antwoord.)

Hoe meet je succes? Niet in FTE-reductie. Maar in wat? Medewerkerstevredenheid? Verloop? Verzuim? Weet je het?

Als je de AI manager of projectleider bent:**

Bouw je dit alleen? Of samen met medewerkers, HR, met managers?

Wie bepaalt go-live? Jij, of de mensen die het moeten gebruiken? Verschil is cruciaal.

Hoeveel tijd heb je? Voor itereren, voor testen, voor falen. En kun je die tijd vasthouden bij druk van boven?

Als je Directeur bent:

Waarom doe je dit? Eerlijk. Kosten besparen? Klanten beter helpen? Anders? Want je “waarom” bepaalt hoe je het doet.

Hoeveel geduld heb je? Break-even duurt 18-24 maanden. Kun je dat verkopen aan je Raad, je aandeelhouders, jezelf?

Wat als je beste mensen vertrekken? Want dat risico is reëel. Wat kost dat? En hoe voorkom je het? Wat zijn je doelen? hoe bereid je je voor?

8.3 Downloads & vervolgstappen

Dit white paper is de basis. Maar je hebt meer nodig.

Binnenkort beschikbaar:

- Implementatiegids: Maand-voor-maand roadmap 2026, concrete acties, templates

- Gespreksgids: 10 scenario’s met voorbeeld-gesprekken

- Checklists & Templates: AI-readiness check, stakeholder-analyse, persoonlijk ontwikkelplan, pulse-check vragenlijst

- Business Case: Volledige financiële onderbouwing met aannames en bronverantwoording

Voor wie dit alles te veel is:

Begin met één ding. Eén gesprek. Met één persoon die je vertrouwt. Vraag: “Wat denk jij écht over AI?” En luister. En kijk wat eruit komt.

8.4 Het begint met een eerlijk gesprek

Ik kan je geen garanties geven. Geen belofte dat het lukt als je deze aanpak volgt. Want er zijn te veel variabelen. Cultuur, mensen, geschiedenis, timing.

Maar ik kan je dit wel vertellen: elke succesvolle implementatie die ik gezien heb, als het gaat om automatisering, robotisering of AI, begon met eerlijkheid. Over angsten, onzekerheden, over beslissingen of macht, over budgetten en consequenties.

En elke mislukking begon met mooipraterij. Met presentaties vol “exciting opportunities” terwijl iedereen weet dat het om kosten gaat. Met managers die “no worries” zeggen maar zelf wakker liggen. Met technology-first en people-second.

De techniek is het makkelijke deel. Systemen bouwen, API’s koppelen, modellen trainen—dat kan. Daar zijn handleidingen en experts voor.

Maar mensen meekrijgen? Hun angst serieus nemen? Hun cynisme doorbreken? Hun energie richting geven? Dat is het moeilijke deel. En daar is geen handleiding voor.

Alleen dit: begin met luisteren. Écht luisteren. En kijk waar dat gesprek je brengt.

Want misschien—en ik gooi dit erbovenop als laatste gedachte—is de vraag niet: “Hoe implementeren we AI?” Maar: “Wat voor organisatie willen we zijn?”

AI is een keuze. Maar ook een spiegel. Wat zie je als je erin kijkt?

Verder lezen?

Dit boek over AI door schrijver Ethan Mollick kan ik je van harte aanbevelen. Het geeft je insights waar we nu staan met AI, en wat we in de toekomst kunnen verwachten. Gaat AI echt ons werk overnemen? Kan AI zelf denken? Een bestseller in vele talen vertaald. Leest vlot en biedt je inzichten zonder echt technisch te worden:

- Ethan Mollick – “Co-intelligentie: Slimmer werken met AI” (Nederlandse titel)

- Ethan Mollick – “Co-Intelligence: Living and Working with AI” (originele Engelse titel)

- Ethan Mollick – “Cointeligencia: Vivir y trabajar con la IA” (title in Spanish)

- Waarom de CEO van Anthropic waarschuwt voor een massale schok op de arbeidsmarkt

“Elke dag scherper, beter, klantgerichter.” Met SteinBlogs.com.

COLOFON

Auteur: SteinBlogs.com

Specialisaties: Lean/Operational Excellence, Data & HR People Analytics, Contactcenter Performance

Contact: Details

Bronnen & Methodologie:

Dit whitepaper is gebaseerd op analyse van 595 publieke reacties op een nieuwsartikel over AI en reorganisaties (NU.nl, januari 2026), gecombineerd met eigen theorie en praktijk ervaring op 50+ contactcenter-projecten en 12 Lean Six Sigma-trajecten en industrie-benchmarks (Gartner, McKinsey, Forrester) in de periode 2015-2025.

Copyright © 2026. Alle rechten voorbehouden.

Dit whitepaper mag vrijelijk gedeeld worden. Citeren mag, mits met bronvermelding.

English Summary

AI in Contact Centers: From Fear to Action – A Human-Centered Approach

This white paper examines the critical human factors involved in implementing AI in contact centers, based on an analysis of 595 public responses to news about AI-driven reorganizations in the Netherlands. The author, drawing from extensive experience in Lean methodologies, data analytics, and contact center operations, argues that successful AI implementation depends not on technology alone, but on addressing the emotional and psychological dimensions of organizational change.

The analysis reveals five distinct psychological profiles among employees facing AI adoption: the Concerned Professional (25%), the Threatened Employee (30%), the Cynical Realist (18%), the Technology Optimist (12%), and the Detached Observer (10%). Dominant emotions include fear, cynicism, and—surprisingly—hope, though skeptics outnumber optimists four to one. The research identifies a fundamental crisis of trust, with employees perceiving AI initiatives as cost-cutting measures disguised as innovation.

The paper outlines five critical emotional barriers that organizations must address: fear of job loss, distrust of management, skepticism about AI effectiveness, age-related concerns, and feelings of powerlessness. Rather than dismissing these concerns, the author validates their rational basis, pointing to recent mass layoffs at major financial institutions and the historical pattern of broken promises during organizational restructuring.

A central paradox emerges: AI adoption is necessary for competitive survival, yet poor implementation risks losing the institutional knowledge and experienced staff essential for quality service. The solution proposed is a fundamental reframing—from AI as replacement to AI as colleague, from employees as passive recipients to active designers of their future workflow.

The recommended approach spans three phases over approximately three years. Phase 1 (six months) focuses on listening and learning through team conversations, individual discussions, and forming diverse working groups with actual decision-making power. Phase 2 (six months) involves prototyping and testing with small-scale pilots, weekly retrospectives, and strict quality gates controlled by employees, not management. Phase 3 (2027-2030) scales successful implementations while transforming the contact center from a volume-driven operation to a customer success center.

Critical success factors include genuine employee participation from day one, willingness to invest before saving, non-negotiable quality standards, complete transparency about budgets and risks, and permission to fail and learn. The paper warns against common pitfalls: IT departments designing solutions without user input, management pushing for quick ROI, broken promises, impatience with the learning process, and ignoring employee feedback.

Two contrasting scenarios illustrate the stakes. Scenario A follows traditional top-down implementation, resulting in chaos, customer dissatisfaction, employee departures, and project abandonment after €500,000 in wasted investment. Scenario B demonstrates human-centered change, achieving improved NPS, reduced costs through efficiency rather than layoffs, decreased turnover, and becoming an industry benchmark.

The paper concludes not with prescriptive steps but with reflective questions for managers, HR professionals, IT leaders, and executives. It emphasizes that AI implementation is ultimately a mirror reflecting organizational values—revealing whether leadership prioritizes short-term cost savings or long-term sustainability, whether they view employees as costs or assets, and whether they have the courage to share control and embrace vulnerability.

The fundamental insight: the question isn’t “How do we implement AI?” but rather “What kind of organization do we want to be?” Technology is merely the catalyst forcing organizations to confront this deeper choice.

Resumen en Español

IA en Centros de Contacto: Del Miedo a la Acción – Un Enfoque Centrado en las Personas

Este documento técnico examina los factores humanos críticos en la implementación de IA en centros de contacto, basándose en un análisis de 595 respuestas públicas a noticias sobre reorganizaciones impulsadas por IA en los Países Bajos. El autor, con amplia experiencia en metodologías Lean, analítica de datos y operaciones de centros de contacto, argumenta que el éxito de la implementación de IA no depende únicamente de la tecnología, sino de abordar las dimensiones emocionales y psicológicas del cambio organizacional.

El análisis revela cinco perfiles psicológicos distintos entre los empleados que enfrentan la adopción de IA: el Profesional Preocupado (25%), el Empleado Amenazado (30%), el Realista Cínico (18%), el Optimista Tecnológico (12%) y el Observador Desapegado (10%). Las emociones dominantes incluyen miedo, cinismo y—sorprendentemente—esperanza, aunque los escépticos superan a los optimistas en una proporción de cuatro a uno. La investigación identifica una crisis fundamental de confianza, con empleados que perciben las iniciativas de IA como medidas de reducción de costes disfrazadas de innovación.

El documento describe cinco barreras emocionales críticas que las organizaciones deben abordar: miedo a la pérdida del empleo, desconfianza en la dirección, escepticismo sobre la efectividad de la IA, preocupaciones relacionadas con la edad y sentimientos de impotencia. En lugar de desestimar estas inquietudes, el autor valida su base racional, señalando los recientes despidos masivos en grandes instituciones financieras y el patrón histórico de promesas incumplidas durante las reestructuraciones organizacionales.

Emerge una paradoja central: la adopción de IA es necesaria para la supervivencia competitiva, pero una implementación deficiente arriesga perder el conocimiento institucional y el personal experimentado esencial para un servicio de calidad. La solución propuesta es un replanteamiento fundamental—de la IA como reemplazo a la IA como colega, de los empleados como receptores pasivos a diseñadores activos de su futuro flujo de trabajo.

El enfoque recomendado abarca tres fases durante aproximadamente tres años. La Fase 1 (seis meses) se centra en escuchar y aprender mediante conversaciones de equipo, discusiones individuales y la formación de grupos de trabajo diversos con poder real de decisión. La Fase 2 (seis meses) implica prototipos y pruebas con pilotos a pequeña escala, retrospectivas semanales y controles de calidad estrictos controlados por los empleados, no por la dirección. La Fase 3 (2027-2030) escala las implementaciones exitosas mientras transforma el centro de contacto de una operación impulsada por volumen a un centro de éxito del cliente.

Los factores críticos de éxito incluyen la participación genuina de los empleados desde el primer día, la disposición a invertir antes de ahorrar, estándares de calidad innegociables, transparencia completa sobre presupuestos y riesgos, y permiso para fallar y aprender. El documento advierte contra errores comunes: departamentos de TI que diseñan soluciones sin aportación de los usuarios, dirección que presiona por un retorno de inversión rápido, promesas incumplidas, impaciencia con el proceso de aprendizaje e ignorar la retroalimentación de los empleados.

Dos escenarios contrastantes ilustran lo que está en juego. El Escenario A sigue una implementación tradicional de arriba hacia abajo, resultando en caos, insatisfacción del cliente, salidas de empleados y abandono del proyecto tras 500.000 € en inversión desperdiciada. El Escenario B demuestra un cambio centrado en las personas, logrando mejoras en NPS, reducción de costes mediante eficiencia en lugar de despidos, disminución de la rotación y convirtiéndose en referencia del sector.

El documento concluye no con pasos prescriptivos sino con preguntas reflexivas para directivos, profesionales de RRHH, líderes de TI y ejecutivos. Enfatiza que la implementación de IA es en última instancia un espejo que refleja los valores organizacionales—revelando si el liderazgo prioriza el ahorro de costes a corto plazo o la sostenibilidad a largo plazo, si considera a los empleados como costes o como activos, y si tiene el coraje de compartir el control y abrazar la vulnerabilidad.

La perspectiva fundamental: la pregunta no es “¿Cómo implementamos la IA?” sino más bien “¿Qué tipo de organización queremos ser?” La tecnología es meramente el catalizador que obliga a las organizaciones a confrontar esta elección más profunda.